การศึกษาเรื่อง AI Bias และ Fairness

AI Bias คือปัญหาที่เกิดขึ้นเมื่อระบบปัญญาประดิษฐ์ (AI) หรือแบบจำลองทางคณิตศาสตร์มีการตัดสินใจหรือการทำนายที่เอื้อต่อกลุ่มบางกลุ่มและไม่เอื้อต่อกลุ่มอื่น ๆ ซึ่งอาจทำให้เกิดความไม่เท่าเทียมและความยุติธรรมในการทำให้ประสบการณ์หรือผลลัพธ์ที่ไม่ถูกต้องสำหรับบุคคลหรือกลุ่มที่ถูกกำหนดให้เป็นกลุ่มหมวดหมู่ใดๆ

ปัญหานี้สามารถเกิดขึ้นเนื่องจากข้อมูลที่ใช้ฝึกอบรมแบบจำลองมีความเอื้อต่อแบบความยุติ ยกตัวอย่างเช่น หากแบบจำลองถูกฝึกด้วยข้อมูลที่มีแบบแผนการเลือกบุคคลในตำแหน่งบนเทคโนโลยีสูง แล้วระบบอาจมีความเอื้อต่อเหล่าคนในตำแหน่งนั้นมากกว่าคนในตำแหน่งที่ต่ำกว่า ซึ่งทำให้การตัดสินใจเป็นไปไม่เท่าเทียมและยุติธรรม

เรื่องการให้ความยุติและความไม่เท่าเทียมเกิดขึ้นในแบบจำลอง AI ไม่ได้เกี่ยวข้องเฉพาะกับข้อมูลการฝึกอบรมเท่านั้น แต่ยังเกี่ยวข้องกับขั้นตอนอื่น ๆ ในกระบวนการสร้างและใช้งาน AI ด้วย เช่น การเลือกคุณสมบัติ (feature selection), การปรับแต่งแบบจำลอง, การกำหนดน้ำหนักในการทำนาย, และอื่นๆ

เพื่อแก้ไขปัญหา AI Bias และความไม่เท่าเทียมในระบบปัญญาประดิษฐ์ การศึกษาและปฏิบัติตามหลักการ Fairness จึงเป็นสิ่งสำคัญ แนวทางสำคัญที่ช่วยในการแก้ไขปัญหาเหล่านี้ได้คือ:

1.การตรวจสอบและประเมิน : ตรวจสอบและประเมินระบบปัญญาประดิษฐ์เพื่อระบุความยุติและความไม่เท่าเทียม และทำการทดสอบกับกลุ่มที่แตกต่างกัน

2.การสร้างข้อมูลที่แยกแยะและเคร่งครัด : สร้างข้อมูลที่แยกแยะและไม่มีความยุติเพื่อฝึกอบรมแบบจำลอง

3.การปรับแต่งและตรวจสอบแบบจำลอง : ปรับแต่งและตรวจสอบแบบจำลองเพื่อลดความยุติและความไม่เท่าเทียม

4.การใช้เทคนิคเชิงคณิตศาสตร์ : ใช้เทคนิคทางคณิตศาสตร์เพื่อปรับน้ำหนัก, แก้ไขค่าในแบบจำลอง, และปรับแก้ความยุติ

5.การควบคุมและการโปรแกรมแบบจำลอง : ควบคุมกระบวนการทำงานของแบบจำลองเพื่อให้มั่นใจว่าการตัดสินใจที่ตัดสินใจถูกต้องและไม่มีความยุติ

6.การควบคุมการส่งผ่านและการใช้งาน : ปรับน้ำหนักหรือปรับแต่งแบบจำลองก่อนการนำไปใช้งานจริงเพื่อให้มั่นใจว่ามีความเท่าเทียมและไม่มีความยุติในผลลัพธ์ที่สร้างขึ้น

การแก้ไขปัญหา AI Bias และ Fairness เป็นส่วนสำคัญในการพัฒนาและปรับใช้ระบบปัญญาประดิษฐ์ในสังคม ทำให้ระบบที่ถูกสร้างขึ้นมีความยุติน้อยลงและมีความเท่าเทียมในการให้บริการแก่ทุกกลุ่มคน

ที่มา: ChatGPT

คณะที่เรียนจบยากที่สุดในประเทศไทย

คณะที่เรียนจบยากที่สุดในประเทศไทย คณะไหนมีนักศึกษาลาออกกลางทาง มากที่สุด?

คณะไหนมีนักศึกษาลาออกกลางทาง มากที่สุด? 6 ประเทศที่ไม่มีกลางวัน

6 ประเทศที่ไม่มีกลางวัน สิบเลขขายดีแม่จำเนียร งวด 16/5/69

สิบเลขขายดีแม่จำเนียร งวด 16/5/69 จังหวัดที่คนอยากย้ายออกมากที่สุด” คือจังหวัดไหน?

จังหวัดที่คนอยากย้ายออกมากที่สุด” คือจังหวัดไหน? มหาวิทยาลัยที่ได้งบประมาณมากที่สุดในประเทศไทย

มหาวิทยาลัยที่ได้งบประมาณมากที่สุดในประเทศไทย ใช้ปลั๊กไฟมาทั้งชีวิต เพิ่งรู้ ว่ารูเล็กๆ บนขา มีไว้ทำแบบนี้นี่เอง

ใช้ปลั๊กไฟมาทั้งชีวิต เพิ่งรู้ ว่ารูเล็กๆ บนขา มีไว้ทำแบบนี้นี่เอง จังหวัดที่คนย้ายไปแล้วไม่อยากกลับกรุงเทพ”

จังหวัดที่คนย้ายไปแล้วไม่อยากกลับกรุงเทพ” อำเภอในประเทศไทยที่ยังไม่มีร้าน 7-Eleven เปิดให้บริการ

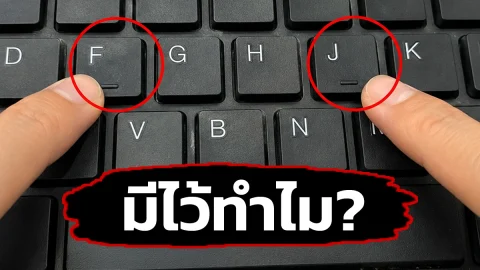

อำเภอในประเทศไทยที่ยังไม่มีร้าน 7-Eleven เปิดให้บริการ ใช้คอมมาทั้งชีวิตเพิ่งรู้! ขีดนูนบนปุ่ม F และ J มีไว้ทำไม?

ใช้คอมมาทั้งชีวิตเพิ่งรู้! ขีดนูนบนปุ่ม F และ J มีไว้ทำไม? ก่อนเปลี่ยนรถ ลองดูค่าใช้จ่าย 3 ปี EV ไฮบริด น้ำมัน แบบไหนคุ้มกว่า

ก่อนเปลี่ยนรถ ลองดูค่าใช้จ่าย 3 ปี EV ไฮบริด น้ำมัน แบบไหนคุ้มกว่า แนวทางเลขเด็ดงวด 16 พฤษภาคม 2569 เลขเด่น 7 ถูกพูดถึงอีกครั้ง

แนวทางเลขเด็ดงวด 16 พฤษภาคม 2569 เลขเด่น 7 ถูกพูดถึงอีกครั้ง